2025年8月4日(当地时间),开发2D与3D动画软件的Reallusion迎来了公司创立25周年。值此重要里程碑,公司宣布推出一系列新AI工具与新政策。其中最受瞩目的,便是新插件「AI Render」的开放测试版正式上线。

从3D创新迈向AI加速时代

自创立以来,Reallusion一直致力于帮助数百万创作者更快地制作动画、更智能地设计,并拓展实时3D的可能性。如今,公司正迎来由AI驱动的全新动画时代。通过将AI渲染、智能检索与叙事功能融入iClone和Character Creator等强大的实时工具中,Reallusion旨在进一步提升创作体验。

Reallusion市场营销副总裁约翰·马丁二世(John Martin II)表示:

“我们始终支持创作者快速行动、用心讲述故事。未来,AI将深度整合进制作管线,涵盖场景控制、摄像机动画、角色选角,以及资产的高级检索等各个方面。我们不只是在进化——我们正在为每一位艺术家提供由AI赋能的‘整个工作室的力量’,并由人类的创造力来引领方向。”——John Martin II,Reallusion市场营销副总裁

全新内容授权政策

借25周年之际,Reallusion宣布对其内容授权政策进行重大更新。创作者将获得前所未有的自由,可将资产导出并复用于各类平台。

标准授权全面开放——扩展授权成历史

新标准授权允许用户在Unreal Engine、Unity、Maya、Blender等第三方平台中无限制使用所购内容。这意味着过去必需的扩展授权已成为过去,跨平台无缝工作流正式实现。

【标准授权主要优势】

- 可大规模分发资产用于图像、视频、游戏及XR项目

- 支持将内容导出至任意第三方平台、软件、工具或引擎

- 所购角色与资产可无限次复用于任意项目

- 无需再受复杂规则困扰,自由扩展内容库

面向内部工作流的低成本「iContent」

针对仅在Reallusion生态内完成工作的用户,公司将推出全新「iContent授权」。该授权价格仅为标准授权的30%,即可获得高质量内容。

【iContent适用场景】

- 希望使用便捷的应用内购买功能

- 直接在iClone或Character Creator中进行渲染

- 项目仅在iClone或Character Creator内保存与共享

- 用于预可视化或故事板的场景搭建

- 无需导出至第三方或跨平台部署

资产商店新增AI深度搜索功能

Reallusion资产商店现已上线全新「AI深度搜索(AI Deep Search)」功能。该功能支持自然语言输入与图像搜索,只需用文字描述创意目标,AI即可推荐相关的角色、服装、动作与道具。

此外,所有商店资产现均提供试用权限,创作者可在购买前直接于iClone或Character Creator中测试资产,大幅优化从创意到执行的创作流程。

「AI Render」开放测试版正式上线!

一款强大且完全免费的工具——「AI Render插件」开放测试版现已发布。它能将实时3D动画与AI渲染无缝整合至ComfyUI工作流中。

无论你是想探索创意化、风格化的AI生成,还是为专业制作寻求逐帧一致的精确结果,AI Render都能满足需求。从快速测试艺术构想,到专业级精细调整,它为各类创作者提供了灵活且可扩展的解决方案。

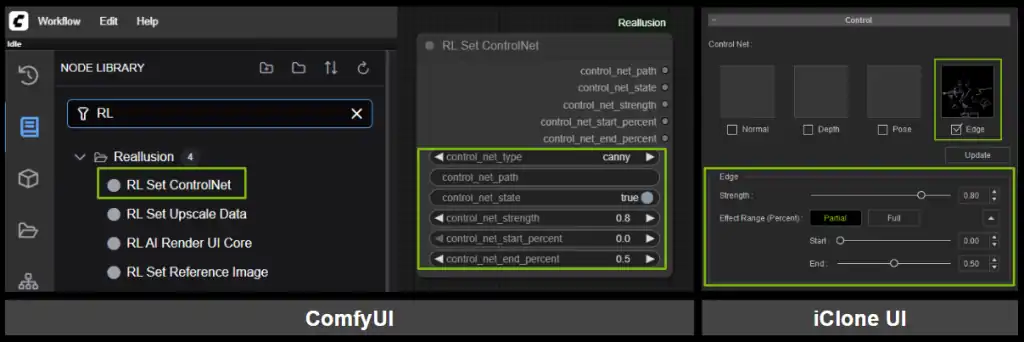

ComfyUI + Reallusion 强强联合

ComfyUI工作流以其支持ControlNet、LoRA及完全可定制管线的灵活节点系统,成为AI艺术社区的强力工具。而Reallusion的Character Creator与iClone则以直观的滑块设计、拖放式资产操作和实时场景编辑,提供高速且对新手友好的创作体验。

AI Render通过自定义节点,将Reallusion的3D环境直接接入ComfyUI生态系统,实现了两者的深度融合。

两种风格预设

AI Render提供22种专业调校的风格预设,涵盖写实、3D与2D三大类别。

静态图像渲染支持11种AI图像生成模型,视频制作则提供11种注重帧间一致性的AI视频生成模型,助你快速启动图像与视频项目。

默认配置采用Stable Diffusion 1.5、Wan2.1 Fun 1.3B Control及Wan2.1 VACE 1.3B模型,可在主流硬件上本地运行,兼顾画质与性能。

对于追求更高阶或电影级效果的用户,AI Render还支持Flux、HiDream、FusionX等第三方高端模型。

这些模型需要更强的GPU性能,或通过RunPod、RunComfy等云GPU平台运行。

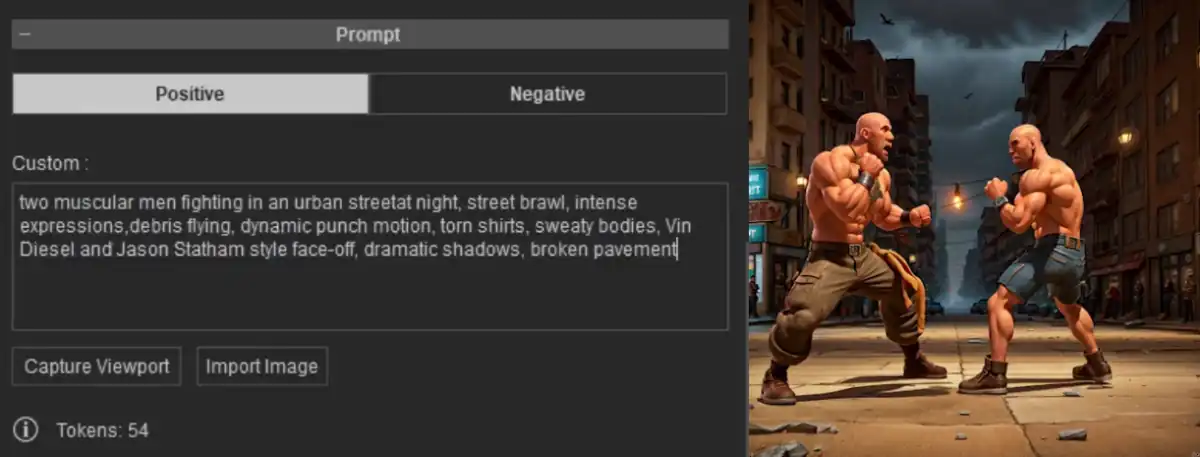

通过文本精细调整AI生成

可通过文本提示词进一步微调生成结果。

使用正向提示词引导AI朝理想风格与特征发展,通过反向提示词排除不想要的元素或畸变,从而获得更精准的输出。

通过参考图确定风格

若难以找到理想风格或不擅长撰写提示词,AI Render支持基于IP适配器的参考图生成。

只需上传图片,AI将遵循其风格、光影与色调进行生成,无需复杂提示词即可获得一致的视觉表现。

支持ControlNet

ControlNet是一种通过深度图、姿态信息等“结构化输入”来精确引导AI图像生成的技术,超越了单纯的文本指令。

AI Render的最大亮点在于,这些结构化输入可直接从iClone或Character Creator的3D环境中生成,且精度完美。

与依赖从2D视频中“推测”结构的通用2D ControlNet不同,3D场景直接生成的数据确保AI每帧都能获得稳定、无误差的引导,从而产出高质量、一致的结果。

结合Reallusion生态庞大的资产库与软件内置的深度搜索功能,可快速构建高质量ControlNet输入的基础场景。

AI Render支持的ControlNet模式如下:

Depth(深度)

生成表现3D场景中各物体与摄像机距离的“深度图”(以黑白灰度表示)。AI借此准确理解场景的前后关系。

相比从2D视频推测深度的方法,此方式完全避免了镜头间距离感的抖动与闪烁。无论从特写切换到广角,角色焦点、细节乃至面部表情的一致性都能完美保持,是稳定视频制作的基石。

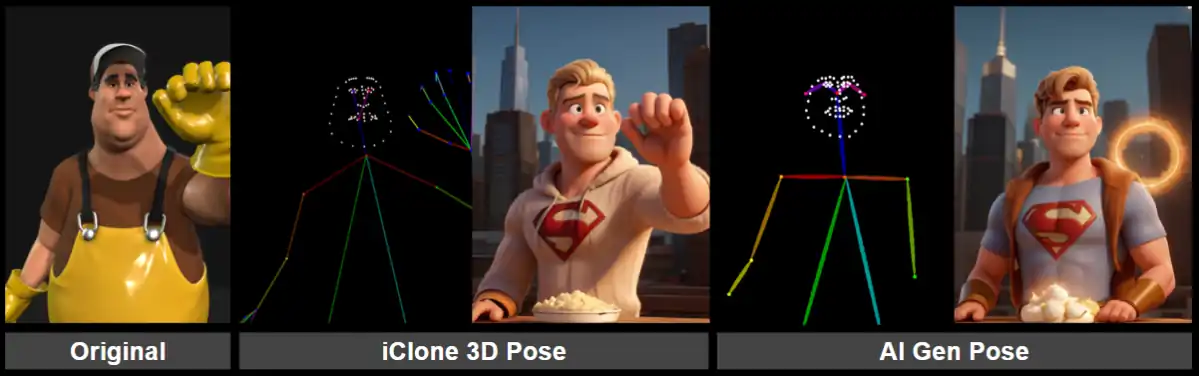

Pose(姿态)

从3D角色内部骨骼(Rig)信息中提取“姿态图”,精确捕捉四肢与关节位置。

2D姿态推测(如OpenPose)常因角色被遮挡或移出画面而丢失肢体追踪。而3D姿态图无论角色动作多复杂,或与其他角色重叠,都能持续精准追踪骨骼信息,确保AI掌握准确的动作时机与身体位置。

Normal(法线)

生成将物体表面朝向(法线)编码为颜色信息的“法线图”,向AI传达光线如何照射表面。

iClone或Character Creator中设置的灯光效果,将忠实地反映在AI生成的光影中。这使得生成结果不仅限于插画风,更能实现立体感强的干净造型、电影级高光与专业品质的视觉效果,且逐帧保持一致。

Edge (Canny)

从3D模型几何信息中提取“边缘图”,仅保留无噪点的干净轮廓线。

此功能特别适合动漫、墨线艺术、线稿等强调清晰线条的风格化渲染。避免了2D边缘提取常见的线条粗细不均或断裂问题。与深度图结合,可明确角色与背景的层次感,实现强大的构图控制。

通过组合上述多种ControlNet输入,可进一步增强对角色与场景的控制。每种输入均可通过阈值滑块调节,精细控制结构强度、影响程度与视觉风格。

此外,该系统与iClone强大的摄像机工具完全联动。在iClone中进行的镜头切换、构图调整或自动化摄像机路径等电影级运镜,都会实时反映在ControlNet输入中。

这让创作者能像实拍电影导演一样,对AI生成的影像进行精确的叙事与视觉指导。

构建专属IP与LoRA

要实现AI生成中的高质量与一致性,LoRA(低秩适配)训练至关重要。LoRA是一种轻量级AI模型,能跨帧、跨场景保持角色独特的外观与感觉。

利用iClone的批量渲染、姿态库与自动化摄像机路径功能,可快速从多角度、多动作中构建LoRA训练所需的数据集。

由此,通过Character Creator与iClone,可创建完全绑定、可直接用于游戏、动画、虚拟制片或商品化的原创角色。这些角色是创作者完全拥有的专业资产。

创建的原创角色可轻松参与AI叙事,在AI生成的电影、广告或创意项目中担任主角。将3D角色导入ComfyUI工作流,AI Render将确保风格一致性,并实现高速、风格化的视频生成。

AI Render 安装与设置指南

可通过以下视频了解安装方法:

系统要求

✅ 操作系统:Windows 10及以上

✅ 显卡:NVIDIA 30系列 8GB(最低要求)。不支持AMD显卡。

✅ 软件版本:Character Creator 4.54 或 iClone 8.54(仅限正式版。试用版不支持)

✅ 推荐存储空间:80 GB

・ComfyUI:主程序 5 GB / 全部模型 60 GB(可选,无需完全安装)

插件下载

- 适用于iClone 8:【点击此处下载】

- 适用于Character Creator 4:【点击此处下载】

- LoRA训练数据集项目:(如需训练自己的LoRA,请从此处下载)【Google Drive下载链接】

渲染时间参考

基于默认模型(图像生成:Stable Diffusion 1.5,视频生成:Wan2.1 Fun 1.3B Control 与 Wan2.1 VACE 1.3B):

- 图像 (512×512):每渲染约5~10秒

- 视频 (512×512, 5秒):每渲染约5~10分钟

评论留言